3.4.3 数据安全问题引发的 AI 信任危机

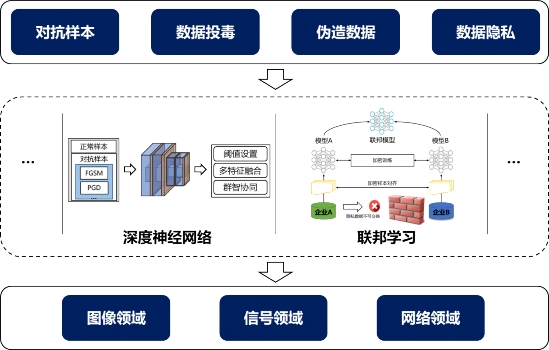

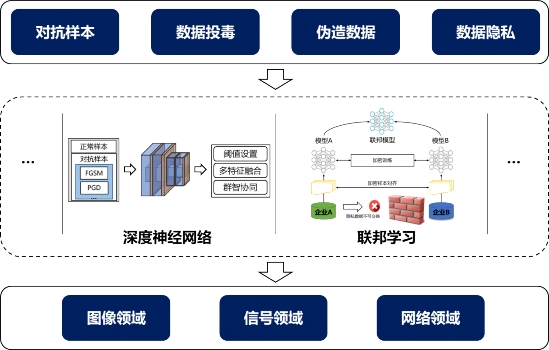

随着“新基建”建设加快推进,智慧工厂、智能交通、智慧城市等项目在全国如火如荼的展开,这些“智”的背后离不开人工智能技术,它早已渗透到生产、生活的方方面面。然而,人工智能极度依赖大数据平台和深度学习技术来帮助形成机器智能,因此外在的数据安全、内在的“黑箱模型”不可解释以及脆弱性漏洞,以及因为深度伪造等技术造成的低成本造假等,也让人们对 AI 技术从最初的全面肯定转变为信任危机,具体情况如图 3-6 所示。

图 3-6 数据安全问题下的多领域 AI 攻防

(1)数据问题

新兴技术与现实生活中经济、生活、文化等方面的交叉融合,产生了海量数据,这些数据的运用将成为未来竞争和发展的基础。特别地,随着深度神经网络的崛起,使得基于深度学习模型的视觉识别、信号处理以及网络分析等研究领域取得了极大的进展,人工智能技术作为大数据挖掘的利器重新走到前列。然而这项造福人类的技术,却频频出现各种风险危机。基于数据的 AI 安全风险,主要有以下四类:

一是对抗样本,对输入数据以一定策略添加细微的干扰,导致

AI 模型输出错误结果,例如机器视觉中的车牌识别误导;

二是数据投毒,是指干预深度学习的训练数据,导致预测模型

输出错误,例如通过控制对话内容影响可训练问答式机器人发表敏感言论;

三是生成伪造数据,指 AI 无中生有自动生成图像、视频、音频等数据,例如深度伪造(Deepfake)技术的 AI 伪造视频、音频等;

四是隐私问题,AI 技术从数据采集、标注到数据分析和挖掘阶段,都存在着信息滥用、泄露等隐私风险,例如以获取 AI 模型隐私为目的的窃取攻击。

(2)技术研究

AI 数据安全性的方法研究方面,主要针对和数据相关的对抗攻击与防御开展。深度学习的攻防研究也最早在图像领域中开展,对抗样本和数据投毒的危害尤为突出,例如:身份认证攻击、人脸检测攻击、场景识别攻击和目标检测攻击等。在电磁空间领域,SDR在信号攻防领域应用日趋广泛,在频谱传感应用、发射器识别、认知干扰和抗干扰等领域也取得了一系列进展,常见的信号攻击方法有:反向工程信号、重放攻击、信号干扰、GPS 欺骗等。在网络空间领域,图神经网络作为深度学习在网络分析应用中的一类重要模型,同样容易受到对抗扰动的攻击,常见攻击方法一般通过重连边、增删节点、修改节点特征等方式实现。

鉴于对抗攻击将带来重大的人身伤害和财产损失,甚至威胁到国家安全,当前针对性的防御策略也获得越来越多的关注。对抗攻击的防御措施主要沿着三个方向发展:在学习中使用改进的训练或在测试中使用修改的输入;修改网络,例如通过添加更多的层/子网络、改变丢失/激活功能等;用外部模型作为网络附件对未知的样本进行分类。

在应用领域方面,目前对抗防御方法已在图像、信号和网络等领域研究开展并应用于一些行业场景,为数据安全问题引发的 AI 信任危机提供更多的可行方案,对抗环境下数据安全和隐私保护,依然是提升 AI 可信的严峻挑战之一。